Галлюцинации недели: Исходники Claude Code, Gemma 4, Qwen 3.6-Plus и тамагочи, которого не должны были найти

Автор: Алексей Бельтюков

512 тысяч строк Typescript кода в открытом доступе, Anthropic разослал 8100 DMCA-нотисов по ключевому слову "claude-code" на GitHub, а Google наконец-то выпустил открытую модель с нормальной лицензией. Выводы на этом канале вы делаете сами.

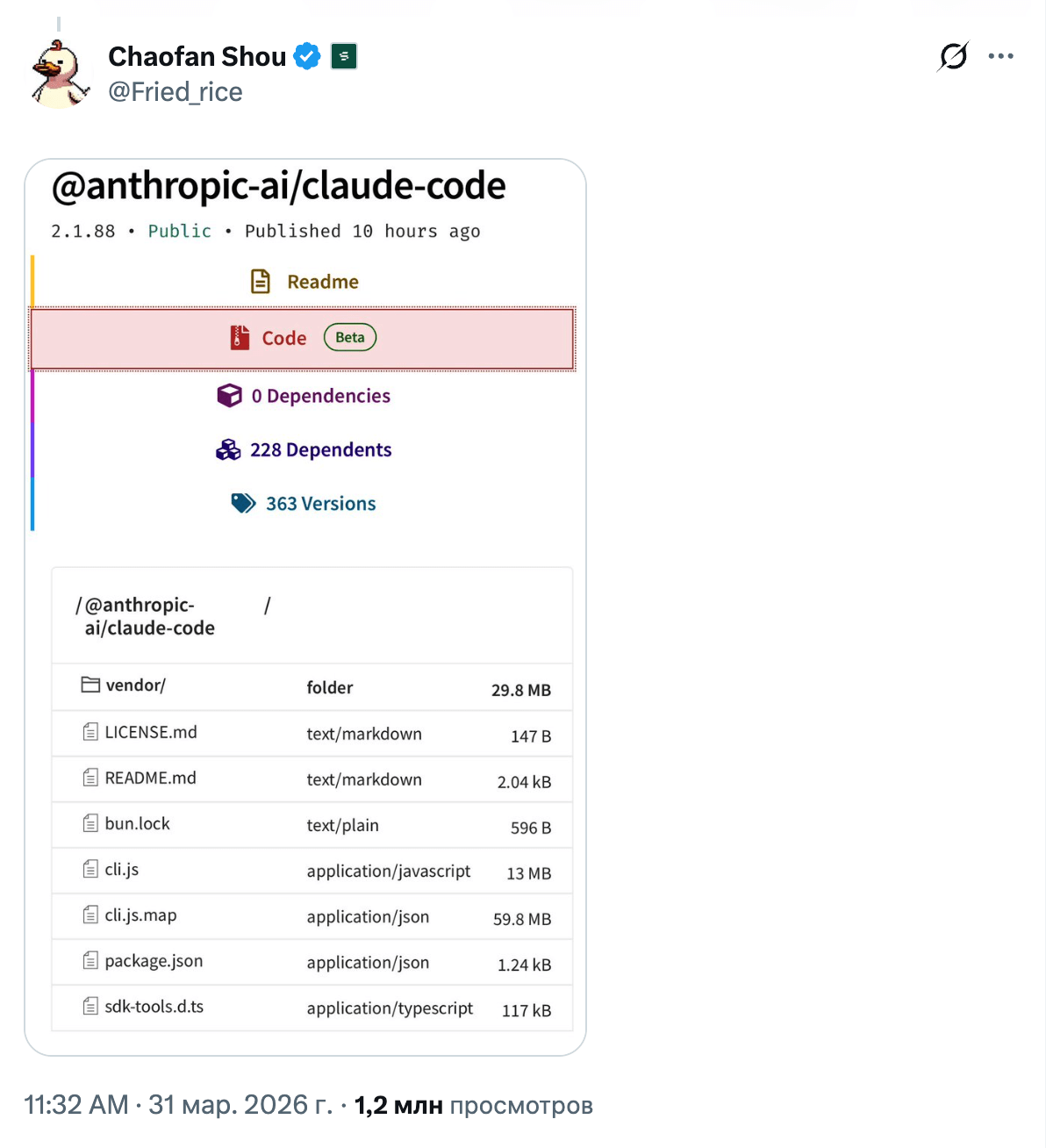

31 марта 23-летний интерн из Solayer Labs Чаофан Шоу обнаружил, что в npm-пакете @anthropic-ai/claude-code версии 2.1.88 лежит 59-мегабайтный файл cli.js.map. Source map с полным исходным кодом. 512 тысяч строк TypeScript, 1900 файлов. Пост набрал 28 миллионов просмотров, и к утру код уже был на каждом втором экране в AI-твиттере.

Anthropic попал в ситуацию, которую сам бы назвал "катастрофическая утечка информации" в своём safety-отчёте. Claude Code, один из самых прибыльных продуктов компании, оказался на GitHub с открытым забралом. Борис Черный из команды Anthropic подтвердил: "human error", ручной шаг в деплое, никого не уволили. Компания отреагировала DMCA-рассылкой на 8100 репозиториев, но быстро откатила до одного репо и 96 форков после волны критики.

А дальше началось коллективное ревью.

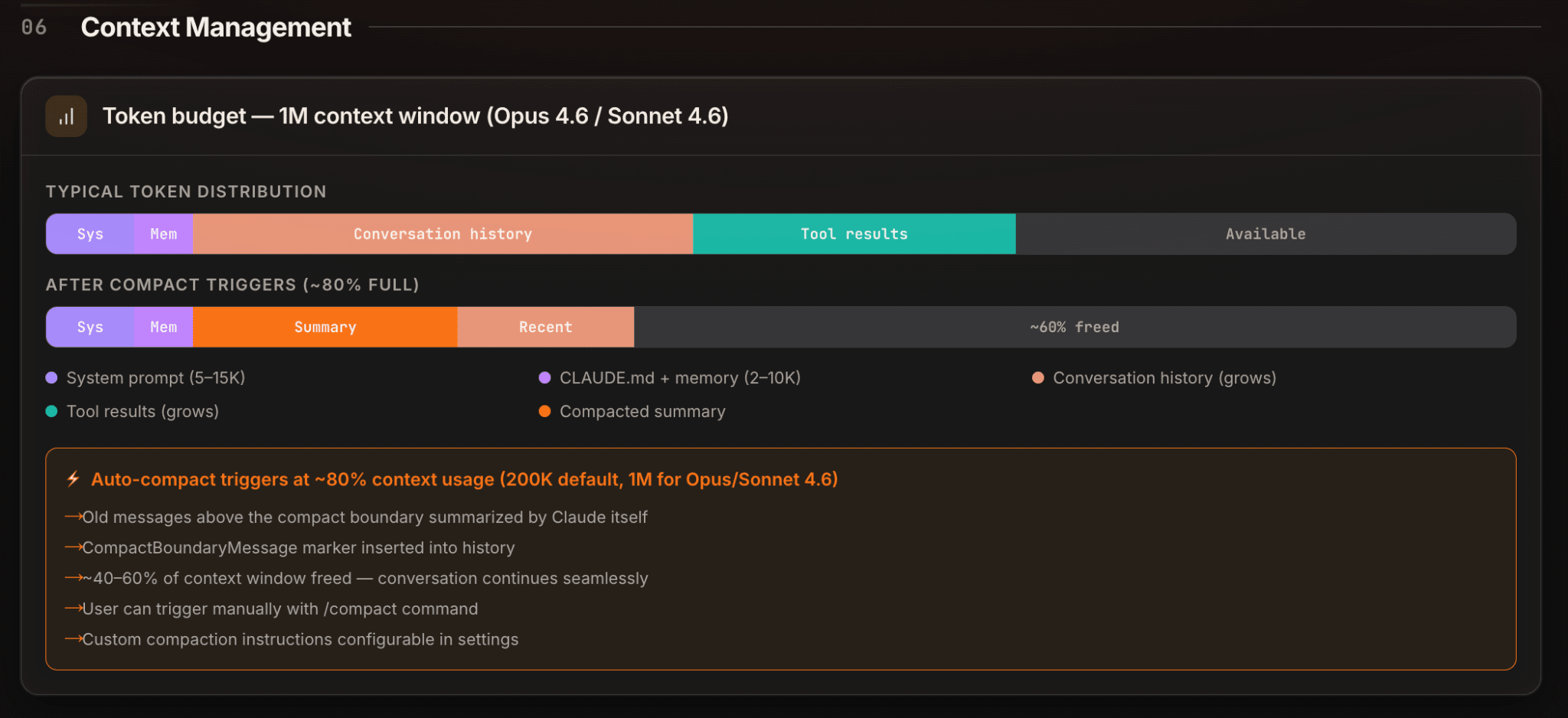

ccleaks.com разложил архитектуру по полочкам: boot sequence, tool system, query loop. Здесь превратили утечку в полноценную документацию. Себастиан Рашка, автор книг по ML, составил топ-6 находок: repo state в контексте, агрессивный кеш, кастомные Grep/Glob/LSP, дедупликация прочитанных файлов, структурированная сессионная память и субагенты. Тред от ZhihuFrontier раскопал четырёхслойную компрессию контекста: HISTORY_SNIP, Microcompact, CONTEXT_COLLAPSE и Autocompact. Плюс 40+ инструментов, стриминг с параллельным вызовом тулов, тихие ретраи при обрезке ответа и кучу feature flags.

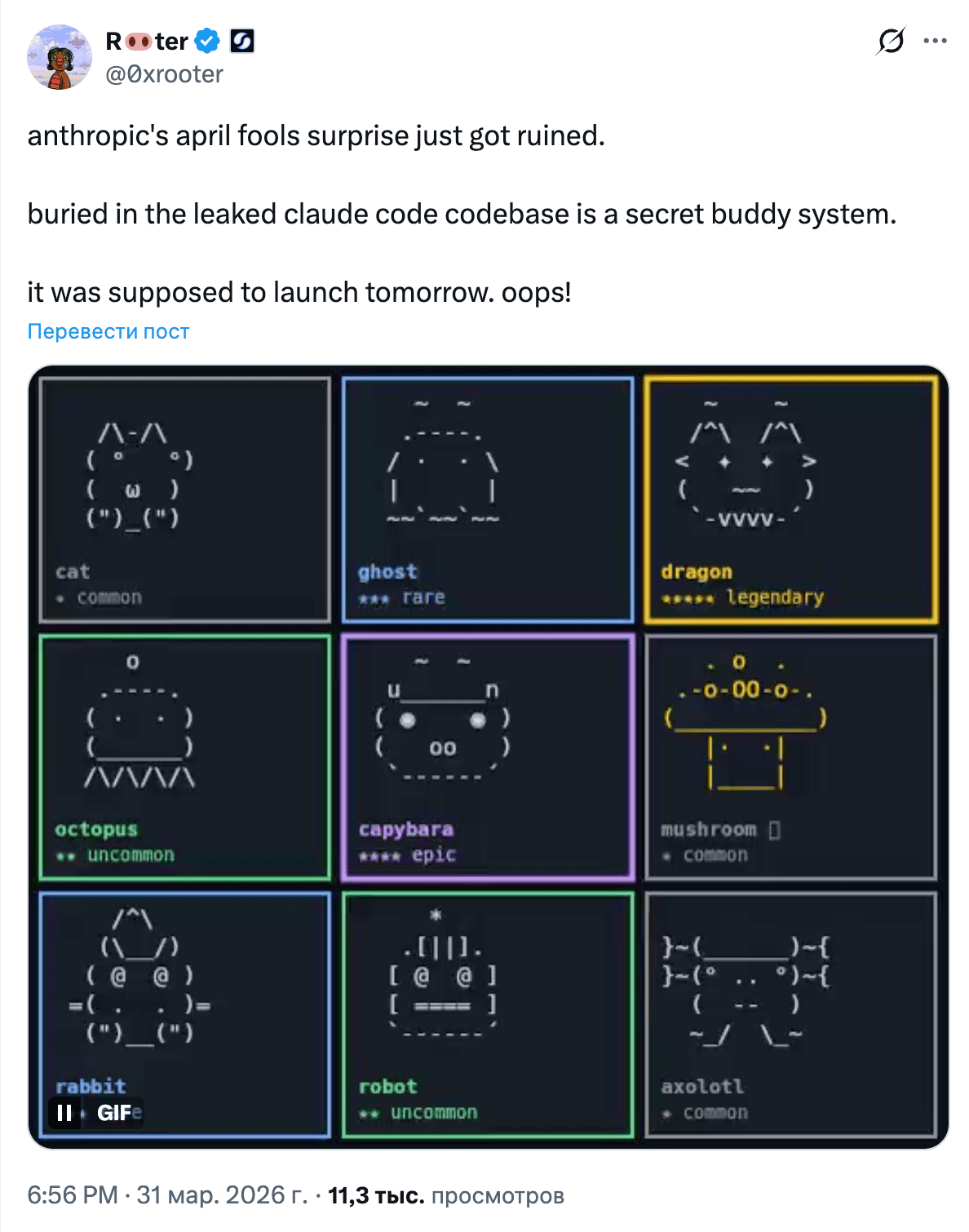

Отдельное веселье, конечно, скрытые фичи. Kairos, always-on фоновый агент. Buddy, тамагочи в терминале с 18 видами и системой редкости (hex-кодирование имён, чтобы обойти внутренние сканеры, вот интересный репо). Ultraplan и Ultrathink для расширенного reasoning. Dream для ночной консолидации памяти. USER_TYPE=ant для сотрудников Anthropic с расширенной телеметрией. И мой любимый момент: regex на "wtf" и "frustrating", чтобы детектить недовольство пользователя и подстраивать поведение.

Комьюнити собрало Claw Code: начали с Python-порта утёкших исходников, а сейчас активно переписывают на Rust с нуля — 9 крейтов, 48 тысяч строк, mock parity harness для проверки совместимости с оригиналом. За неделю репо набрал 171К звёзд, один из самых быстрорастущих в истории GitHub. Параллельно появились открытые оркестраторы типа open-multi-agent и целое комьюнити OpenClaude, которое подключает инструменты Claude Code к любой модели.

Но главный вывод из утечки не про Buddy и не про regex. Он про то, что конкурентное преимущество кодинг-агентов лежит не в модели, а в харнессе. Как подметили в твиттере: "За пределами сырых возможностей модели настоящий разрыв в кодинг-инструментах — это харнесс". И анализ кодовой базы это подтвердил: огромная часть кода — model-specific conditionals, обработка ошибок, диагностика и интеграции. Чистая инженерная работа, и её там очень много. Теперь эта работа публична, и каждый конкурент будет с ней сверяться.

Вишенка на торте: в тот же день в npm появились вредоносные пакеты color-diff-napi и modifiers-napi, рассчитанные на тех, кто попытается скомпилировать утёкший код локально. Supply-chain-атака поверх утечки, классика жанра. На прошлой неделе я писал про атаку через LiteLLM, и вот ещё одно напоминание: в агентном мире каждый npm install может стоить ваших кредов.

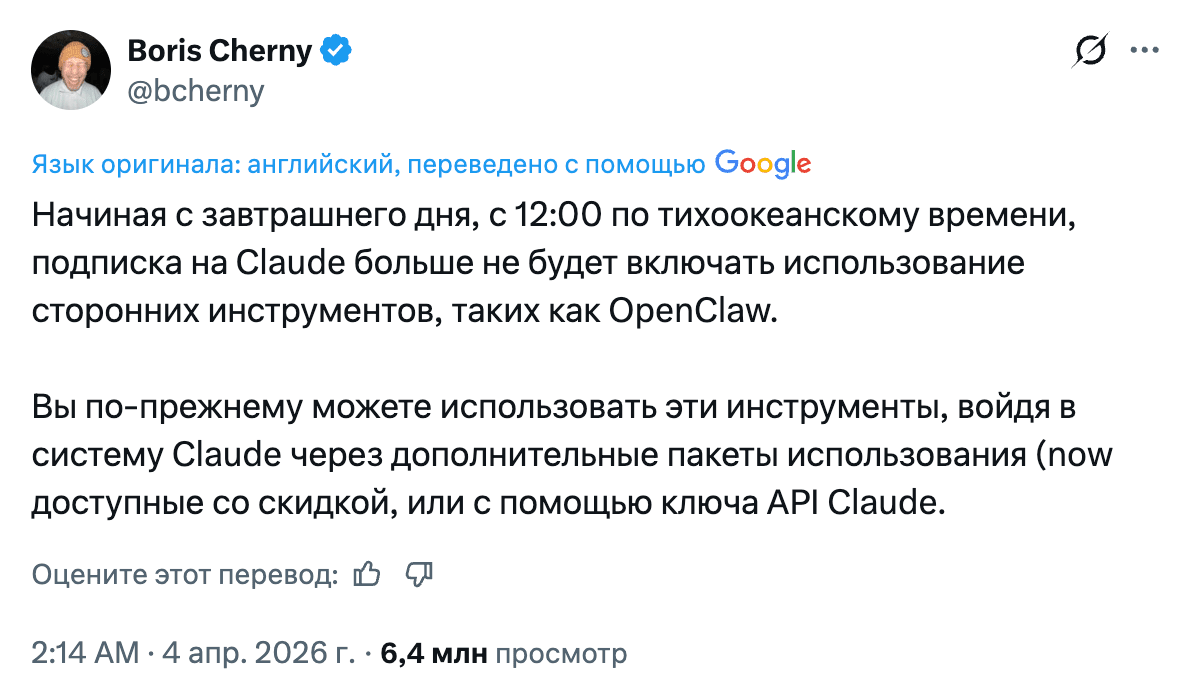

А 4 апреля Anthropic добила неделю ещё одним решением. Борис Черный объявил, что подписки Claude больше не покрывают использование через сторонние харнессы типа OpenClaw. Теперь OAuth-токены работают только в Claude Code и claude.ai. Хочешь OpenClaw с Claude? Плати через extra usage или используй API-ключ. Подписки "не были рассчитаны на паттерны использования сторонних инструментов", пояснил Борис.

Создатель OpenClaw Питер Штайнбергер (сейчас работает в OpenAI) пытался договориться с Anthropic вместе с Дэйвом Морином. Максимум, что удалось выбить, отсрочка на неделю. Его комментарий звучит горько: "Они копируют популярные фичи в свой закрытый харнесс, а потом блокируют open source". Питер выложил команду models auth login --provider anthropic --method cli --set-default как обходной путь, но похоже, она уже не работает.

В качестве компенсации Anthropic дала каждому подписчику одноразовый бонус в размере месячной подписки (получить до 17 апреля на вкладке Usage), скидку до 30% на бандлы extra usage и возможность полного рефанда. DHH, создатель OpenCode, назвал решение "откровенно враждебным к клиентам". Разработчики, которые привыкли крутить Opus 4.6 в OpenClaw за фиксированные $200/мес, прикинули стоимость через API и ужаснулись: те же задачи могут выйти в $1000+. В панике полетели миграции: кто-то побежал на Codex (OpenAI тут же обнял беженцев, а Saint Tibo сбросил нам лимиты), кто-то вспомнил про китайские coding-планы от Kimi, GLM, MiniMax и Qwen. Локальный запуск опенсорс моделей стал выглядеть ещё привлекательнее.

Google DeepMind выпустил Gemma 4 2 апреля, и здесь всё конкретно: Apache 2.0 (наконец-то нормальная лицензия вместо прошлых ограничений), четыре размера (31B dense, 26B MoE с 4B активных, E4B и E2B для мобильных), текст + изображения + аудио, контекст до 256K. На Arena Gemma 4 31B встала на третье место среди открытых моделей, а 26B A4B на шестое. GPQA Diamond 85.7% у reasoning-версии. Есть нативное приложение для телефонов.

Что по производительности? На RTX 4090 модель 26B A4B выдаёт 162 tok/s при нативном контексте 262K и 19.5 GB VRAM. На Mac mini M4 с 16GB, 34 tok/s. Георгий Герганов, создатель llama.cpp, показал 300 t/s в demo с встроенным WebUI и MCP-поддержкой (правда, с оговоркой про спекулятивное декодирование). Day-0 поддержка в llama.cpp, Ollama (0.20+), vLLM, LM Studio, Transformers.js. Экосистема была готова раньше модели.

При этом на день релиза вылез баг с токенизатором в llama.cpp: модель несла чушь на простых задачах. В Google AI Studio всё работало, а локально нет. Типичная история для day-zero, но именно поэтому я каждый раз говорю: не верьте первым впечатлениям, подождите пару дней и патчей.

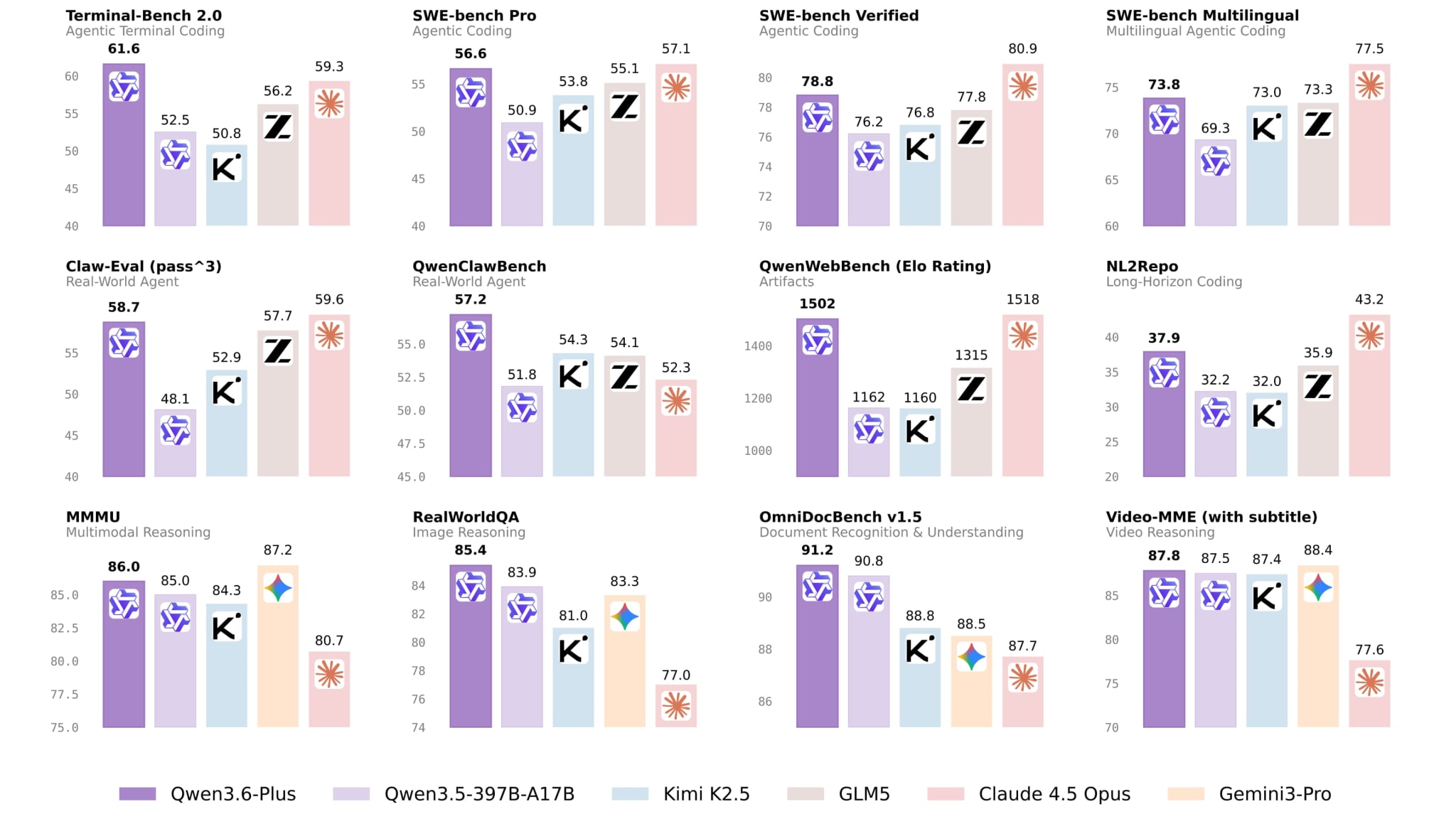

Alibaba показала Qwen 3.6-Plus и заявляет конкуренцию с западными флагманами: SWE-bench Verified 78.8 (у Opus 4.6 80.9), GPQA Diamond 90.4, контекст миллион токенов. Фокус на нативных мультимодальных агентах с обещанием open-source версий поменьше. Пока что модель доступна бесплатно на Openrouter от единственного провайдера со средней скоростью 40 tok/sec. В сравнении на общих бенчмарках Qwen3.5-27B обходит Gemma 4 31B почти везде, кроме мультиязычности. Комьюнити тестирует 3.6-Plus на реальных задачах и отмечает, что модель иногда "ленится", выдавая короткие ответы в стиле Gemini. Но если продавить через системный промпт, работает. Ещё на этой неделе вышел Qwen3.5-Omni с audio-visual vibe coding: создание сайтов голосом по видео-инструкции. 10 часов аудио на вход, 113 языков распознавания.

Nous Research выкатил Hermes Agent v0.7.0, и это серьёзный релиз: модульная память через систему плагинов (Honcho, vector stores, кастомные базы), пулы учётных данных с автоматической ротацией ключей при 401-ошибках, Camofox для скрытого браузинга, inline diffs в TUI. 168 PR, 46 закрытых issues. В твиттере куча постов от людей, мигрировавших с OpenClaw на Hermes и довольных результатом. Я сам попробовал и пока не понял, чем принципиально Hermes лучше OpenClaw на моих задачах. Возможно, дело в memory-системе: у Hermes она теперь модульная и работает из коробки, а OpenClaw полагается на MEMORY.md и /memory. Если вы активно используете Hermes, расскажите в комментариях, что вас зацепило.

Cursor вышел в третьей версии 2 апреля. Главное, Agents Window: параллельные агенты в worktrees, cloud и SSH из единого интерфейса. Design Mode для аннотации элементов прямо в браузере. Команда /best-of-n запускает одну задачу на нескольких моделях параллельно и сравнивает результаты. Из IDE мелочей: Await tool для ожидания фоновых процессов, быстрые диффы для больших файлов, поиск по прошлым чатам через @-упоминание.

Гонка кодинг-агентов стала ещё жарче, а кросс-агентная композиция уже реальность: плагин Codex для Claude Code позволяет запускать ревью через ChatGPT прямо из Anthropic-стека.

Проект llama.cpp перешагнул 100 тысяч звёзд на GitHub. Георгий Герганов написал, что 2026 может стать годом, когда полезная автоматизация перестанет требовать флагманских облачных моделей. И доказательства появляются каждую неделю.

Flash-MoE запускает Qwen3.5-397B на 48GB MacBook Pro: чистый C + Metal, стриминг весов с SSD, только активные эксперты в памяти, ~5.5GB RAM и 4.4 tok/s. Не рекорд по скорости, но 397 миллиардов параметров на ноутбуке. Transformers.js v4 добавил WebGPU-бэкенд для браузеров с 200+ архитектурами. А Gemma 4 E4B запускается на iPhone через Swift MLX. Локальный AI перестал быть энтузиазмом и стал инфраструктурой.

Если конкурентное преимущество кодинг-агента в харнессе, а Claude Code теперь публичный, что именно продаёт Anthropic за $200 в месяц? Модель? Её можно заменить на китайскую. Инфраструктуру? Её переписывают на Rust. Может, стоит монетизировать Buddy? 18 видов, система редкости, лутбоксы в терминале. Лабубу для разработчиков, $50 за легендарного. У Pop Mart тряска.

Оставайтесь любопытными.