Галлюцинации недели: Composer 2, Unsloth Studio и Claude, который нажимает кнопки за вас

Cursor поймали с Kimi под плащом, OpenAI скупает Python-инфраструктуру, Claude учится жить вне терминала, а Unsloth решил, что файн-тюнинг пора отдавать обычным людям. Разбираемся со всем этим.

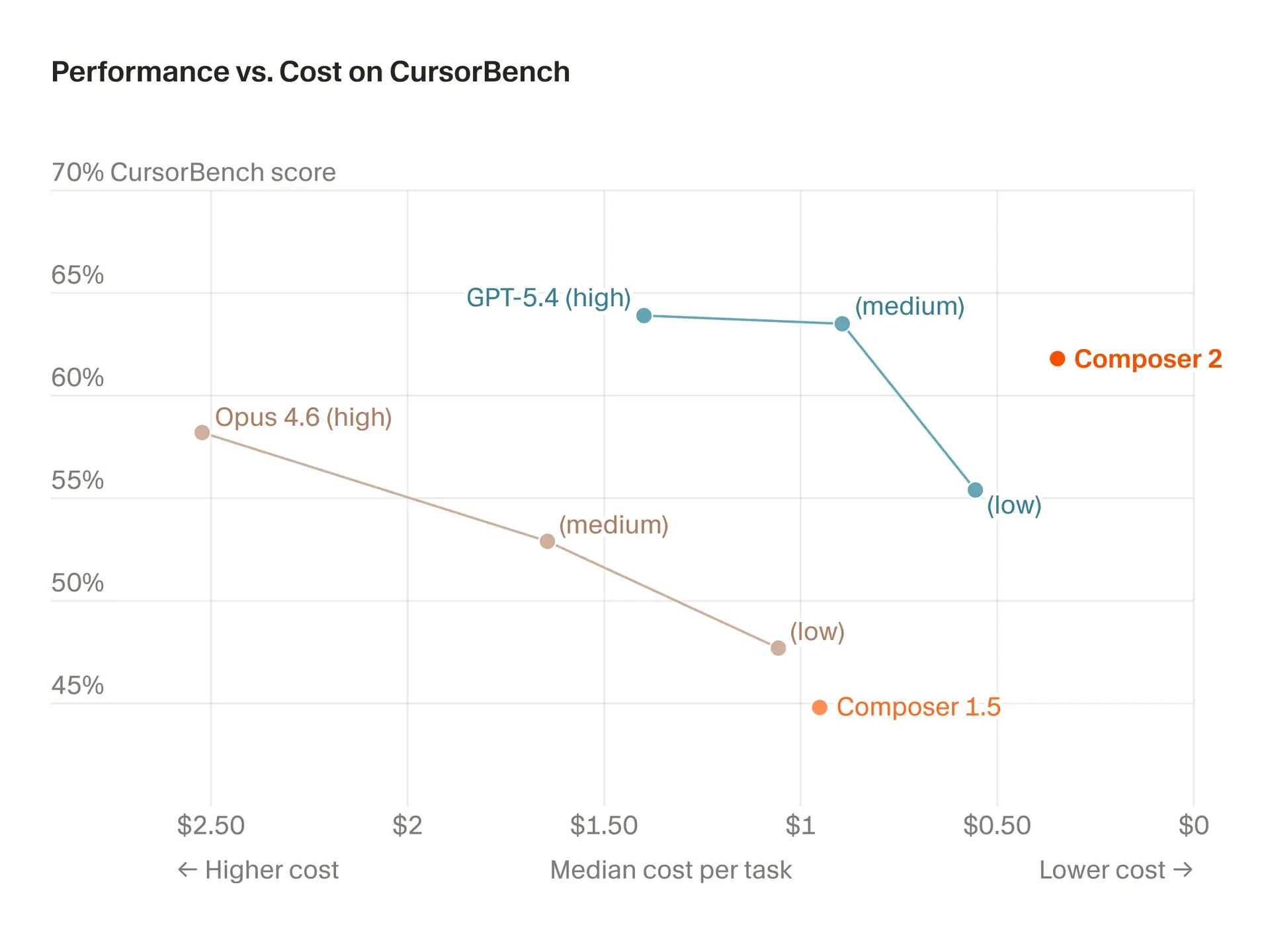

Cursor выпустил Composer 2, и сначала всё выглядело почти образцово. 61.7% на Terminal-Bench 2.0 против 58% у Opus 4.6, цена $0.50/$2.50 за миллион токенов, история про дообучение и RL с серьёзным бюджетом. Для продукта, который многие до сих пор воспринимали как удобную оболочку вокруг чужих моделей, это уже был шаг в новую лигу. Я, честно говоря, сначала тоже подумал: ну всё, Cursor решил окончательно перестать быть просто витриной.

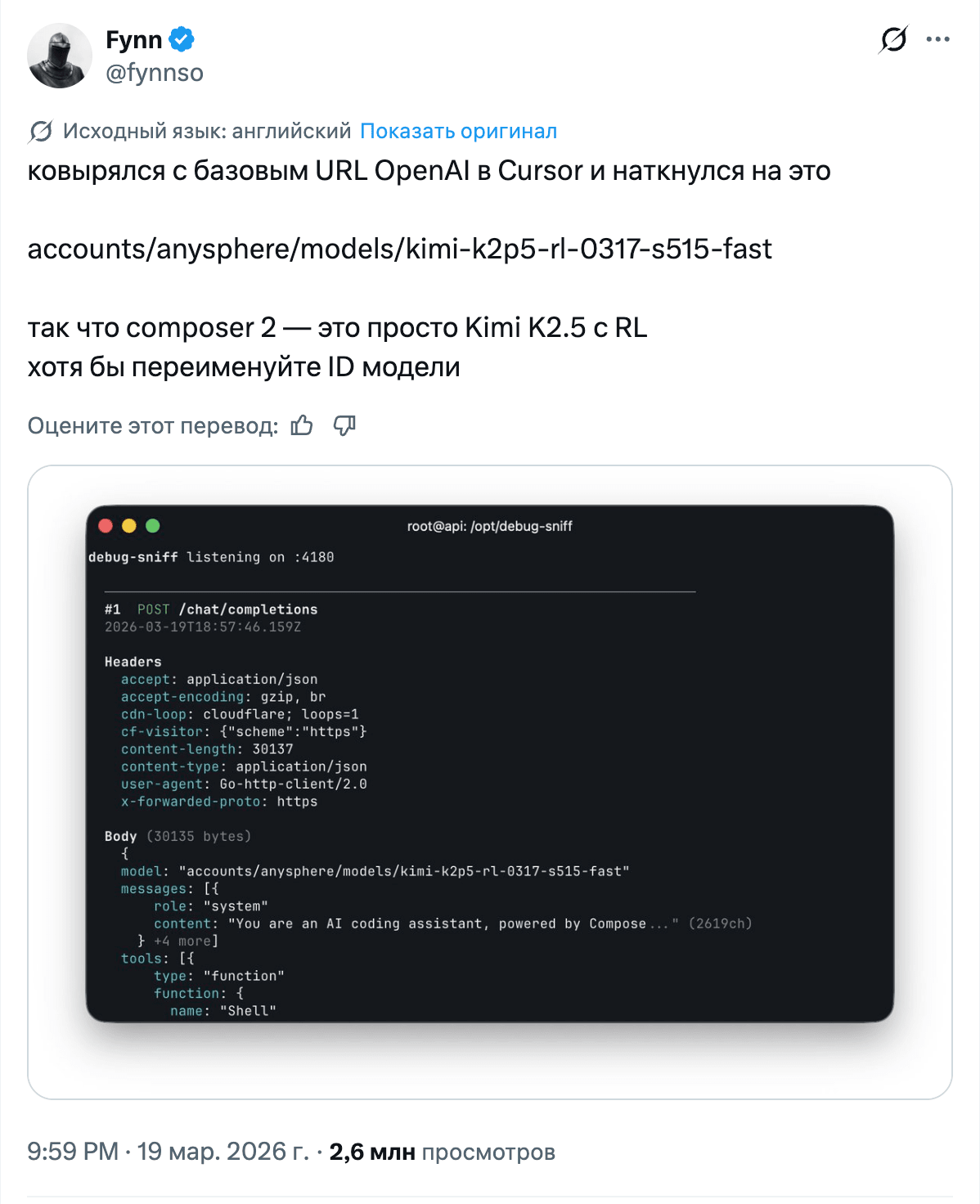

А потом интернет сделал то, что умеет лучше всего. Сначала нашли, что у Composer 2 подозрительно знакомый токенизатор. Потом всплыл URL модели в отладке. Дальше Клемент Деланг из Hugging Face напомнил про лицензионные нюансы Kimi K2.5, а Reddit быстро назначил Cursor обёрткой. Красота длилась недолго.

Через несколько часов Cursor объяснил, что K2.5 действительно была базой, но основная работа уже в их собственном дообучении и RL, а всё это идёт через коммерческое партнёрство с Fireworks. Moonshot AI это подтвердила. Для меня здесь главное не сама драма, а прецедент: большой продукт берёт сильную китайскую open weight модель, доучивает её и продаёт как свой слой ценности. Таких историй будет только больше. Просто в следующий раз их, скорее всего, честнее упакуют словами "на базе X", чтобы не устраивать бесплатный детектив на полдня.

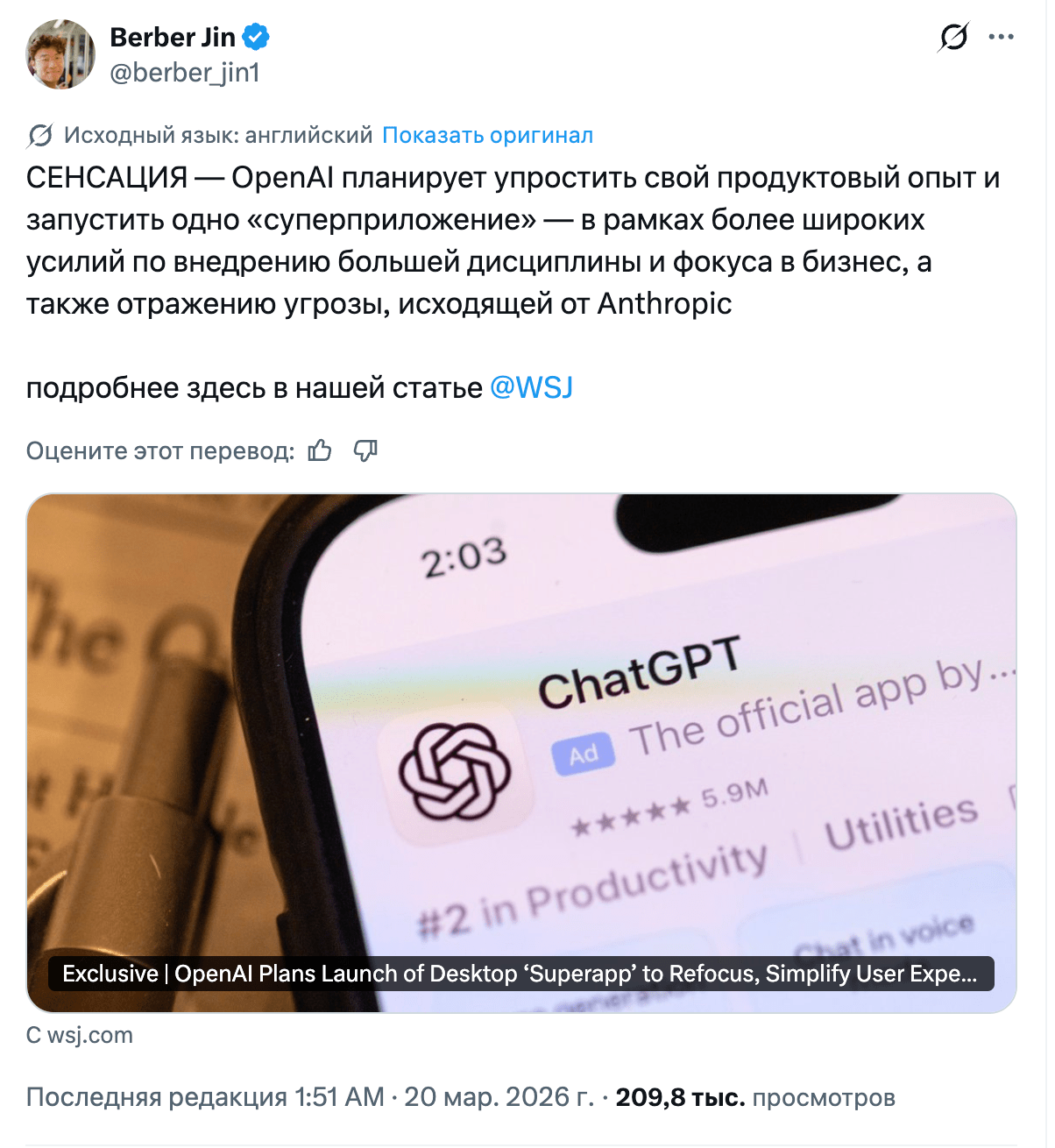

OpenAI тем временем купил Astral, команду uv, ruff и ty. Если вы пишете на Python, вы уже живёте внутри их экосистемы. Я бы даже сказал жестче: многие из нас уже наполовину работают внутри Astral, просто не проговаривают это вслух. Команда Astral вливается в Codex. Google раньше забрал Antigravity, Anthropic купил Bun. Теперь и OpenAI подтягивает к себе дев-инфраструктуру. Лаборатории больше не хотят владеть только моделью. Они хотят владеть пакетом инструментов, через который разработчик вообще работает. На этом фоне слова Фиджи Симо о сворачивании побочных квестов и слиянии ChatGPT с Codex в суперапп звучат очень логично.

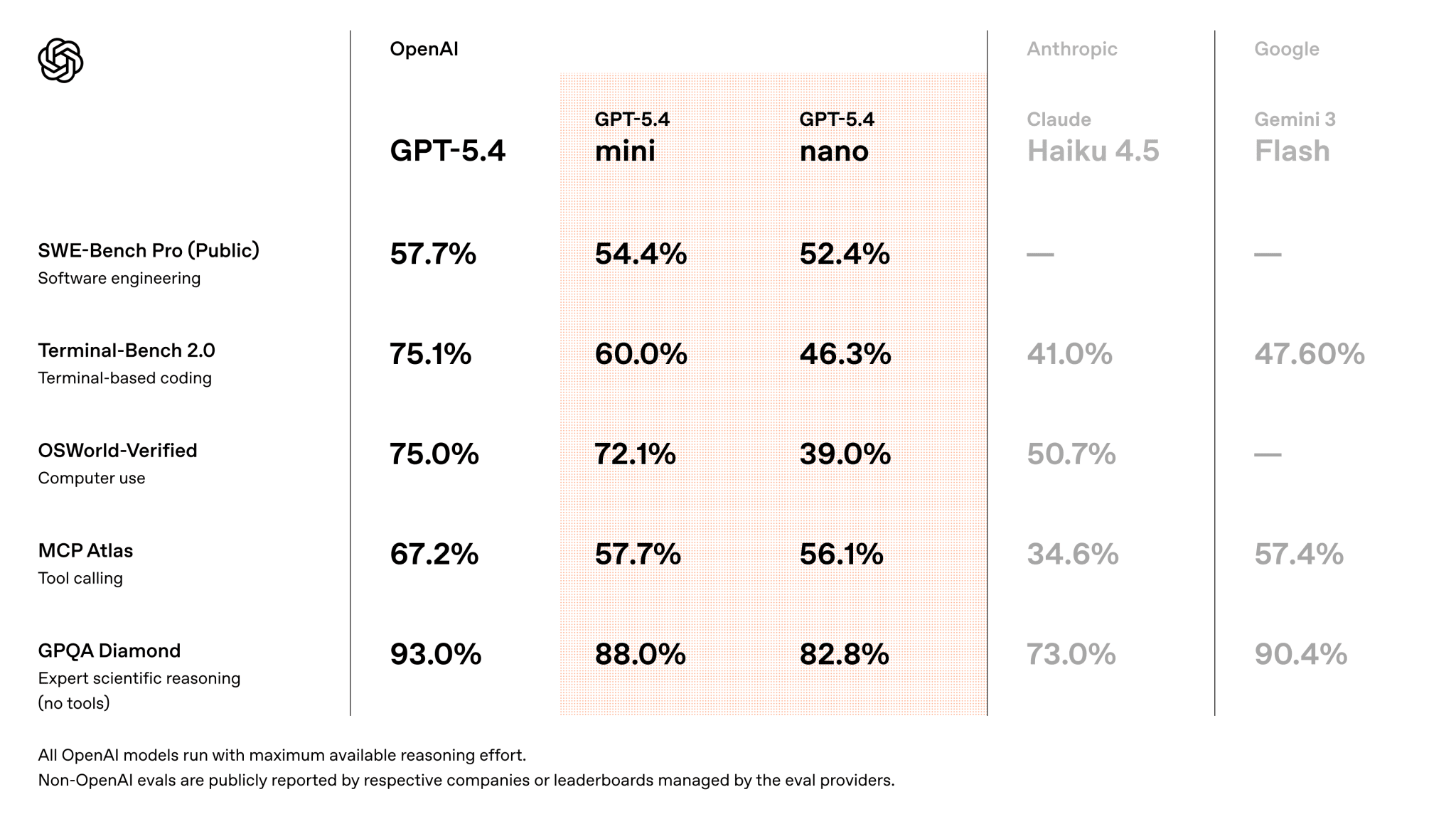

В тот же день OpenAI выкатил GPT-5.4 Mini и Nano. Mini в 2 раза быстрее GPT-5 mini, с контекстом 400k и ценой $0.75/$4.50 за миллион токенов. Но важнее позиционирование: это не "ещё одна младшая модель", а дешёвая рабочая лошадка для фоновых задач, субагентов и всего того, что не хочется отдавать дорогому флагману. В Codex Mini потребляет лишь 30% квоты GPT-5.4, а на APEX-Agents набирает 24.5% Pass@1 с xhigh reasoning. Не чудо-машина. Но для реальной рутины уже более чем достаточно. При этом на BullshitBench новые малышки смотрятся так себе, и это даже полезное напоминание: дешёвая модель для рутины не равна модели, которой можно бездумно отдавать проверку фактов.

Claude со своей стороны получил Computer Use в research preview на macOS. То есть теперь он реально умеет нажимать кнопки, двигать мышь, открывать приложения, ходить по браузеру и заполнять таблицы через Cowork и Claude Code. Рядом появился Dispatch, где задачу можно кинуть с iPhone, а Claude выполнит её уже на десктопе. Саймон Уиллисон и Итан Моллик сравнили это с OpenClaw, причём в пользу Claude. А потом подъехали ещё и Claude Code Channels для Telegram и Discord. Агент для кода перестаёт жить только в терминале. Написал ему в чат, задача ушла в рабочую среду, результат вернулся обратно. Чуть-чуть Black Mirror. Но уже полезный.

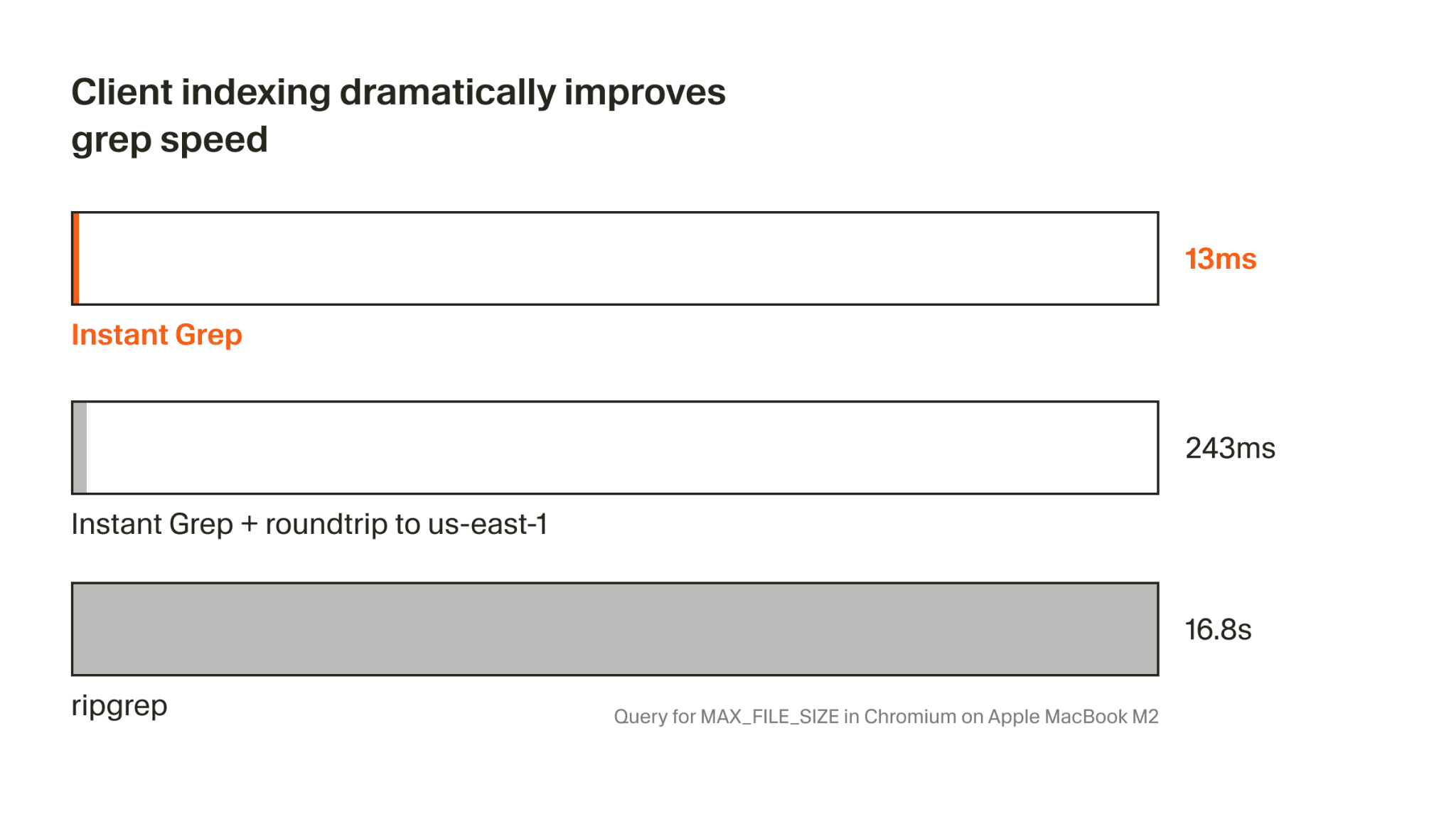

У Cursor в ту же неделю вышел ещё и Instant Grep. Они показали regex-поиск по миллионам файлов за 13 миллисекунд вместо 16.8 секунд на ripgrep. Построено всё на n-граммах, инвертированных индексах и bloom-фильтрах, но суть не в реализации, а в поведении. Для агента поиск по репозиторию это часть мышления. Когда он почти бесплатный по времени, агент может позволить себе больше итераций, больше проверок и гораздо более агрессивную навигацию по коду. Надеюсь, что цифры не приукрашены.

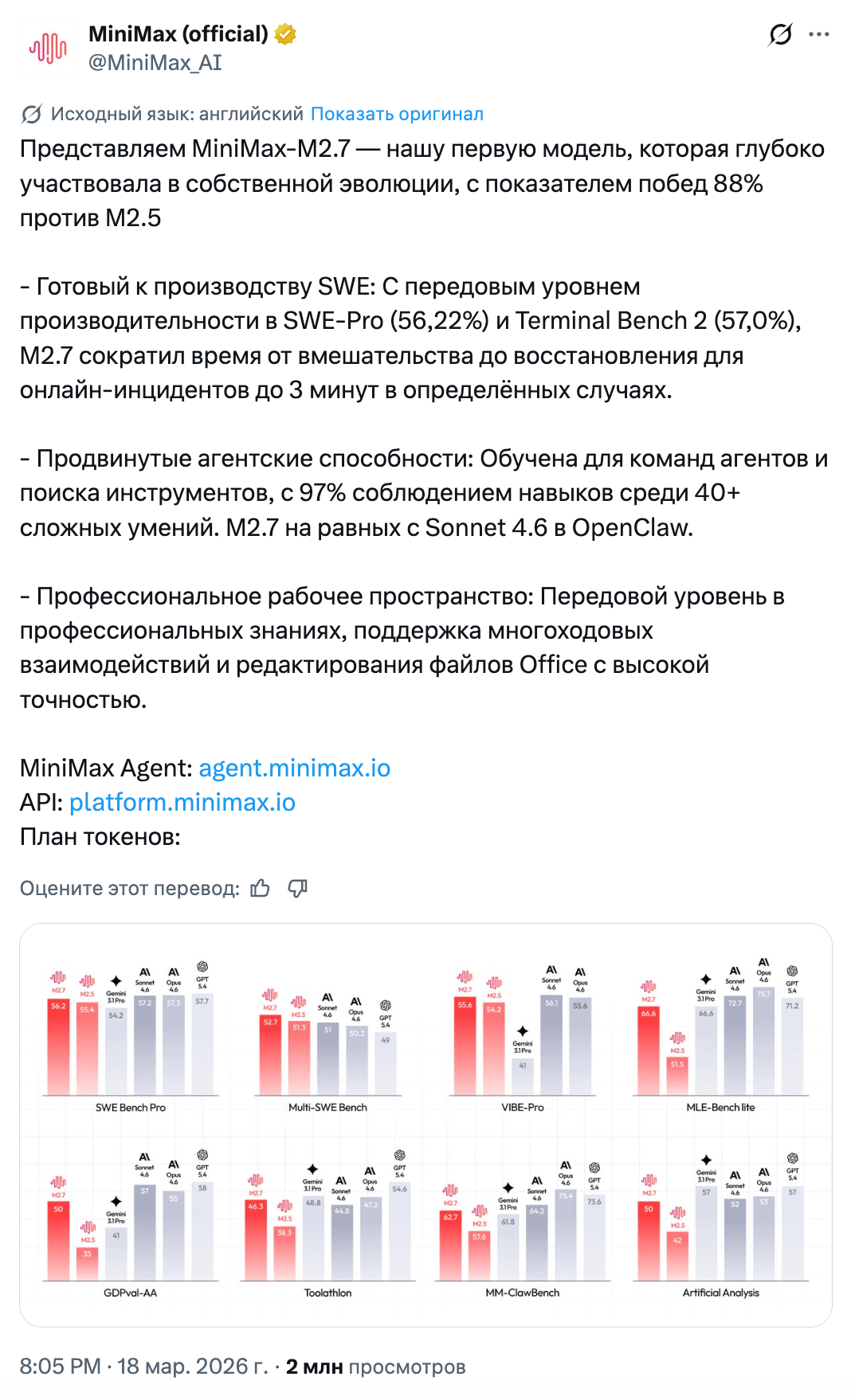

MiniMax выпустил M2.7 и подал её как модель, которая участвует в собственной эволюции. Формулировка слегка театральная, но идея понятная: автономные циклы оптимизации, где модель анализирует ошибки, предлагает изменения, модифицирует код и оценивает результат. 100+ циклов дали +30% на внутренних оценочных наборах. На бенчмарках тоже всё прилично: 56.22% SWE-Pro и 57.0% Terminal Bench 2. Artificial Analysis ставит ей Intelligence Index 50 при цене $0.30/$1.20 за миллион токенов. Модель почти сразу появилась в Ollama, OpenRouter и Vercel, но Reddit справедливо спрашивает, насколько эти цифры реально переносятся в прод.

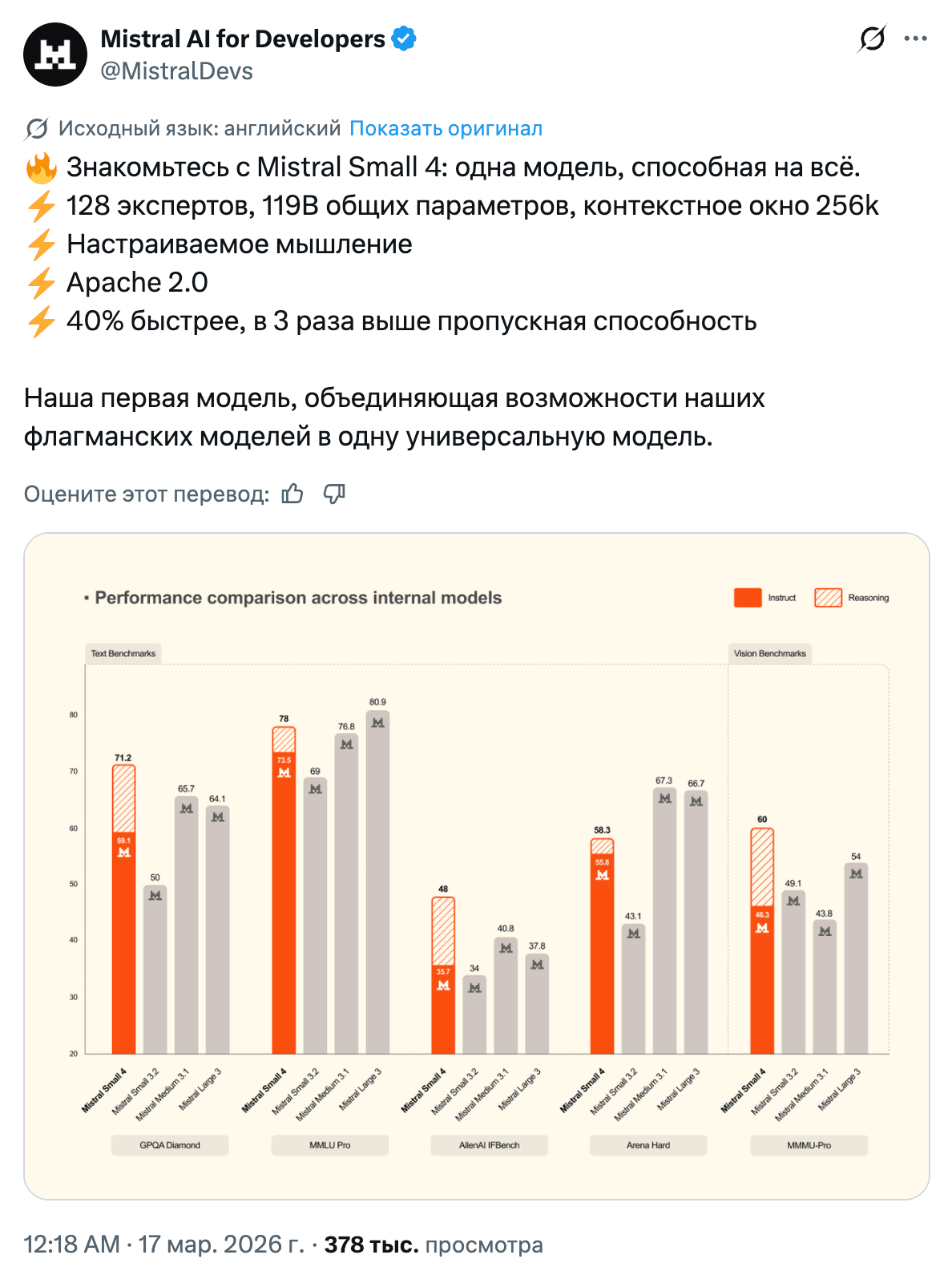

Mistral выпустил Small 4, а Qwen 3.5 Max Preview забрался очень высоко на LMSYS Arena. Рынок моделей среднего веса становится плотным и очень конкурентным: reasoning mode, мультимодальность, длинный контекст, ещё один индекс у Artificial Analysis. А вот у Qwen Image 2.0 тег "Open-Source" сменили на "Release", комьюнити прочитало это как сигнал: открытость прекрасна ровно до тех пор, пока не начинают считать бабосик.

На этом фоне особенно приятно смотрится Unsloth Studio, который вышел как open-source интерфейс для локального запуска и обучения 500+ моделей. У релиза много красивых характеристик: 2x быстрее обучение, до 70% меньше VRAM, поддержка GGUF, vision, audio, embeddings, автосоздание датасетов из PDF, CSV и DOCX. Но если убрать шелуху, главное обещание там очень простое: файн-тюнинг прямо из UI. Я люблю такие релизы больше, чем очередные "самые умные модели на свете", потому что ими хотя бы хочется реально пользоваться. На Reddit Unsloth Studio сразу сравнили с LM Studio, и сравнение для LM Studio довольно неприятное: там в основном инференс, а здесь уже пытаются забрать себе и запуск, и обучение.

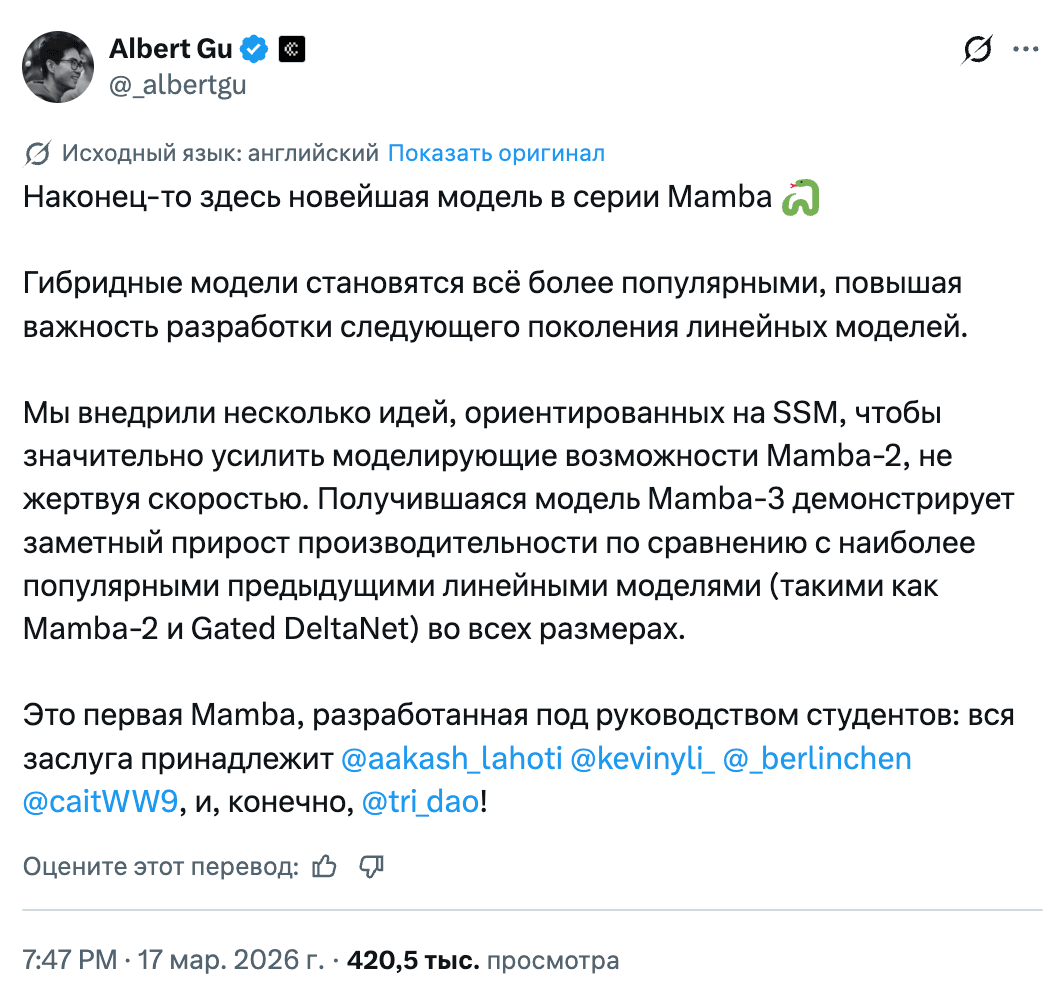

Отдельно отмечу релиз Mamba-3. Как я писал раньше, интерес к SSM и гибридам никуда не делся, потому что чистый attention слишком быстро упирается в цену инференса и длинный контекст. Mamba-3 подают как inference-first SSM и лучшую линейную модель при 1.5B по prefill+decode. Но важнее не маркетинговая формулировка, а тон дискуссии вокруг неё. В Твиттере прямо пишут о замене Gated DeltaNet в гибридных системах, Tri Dao объясняет, что нелинейные RNN-слои добавляют то, чего не дают ни attention, ни линейные SSM сами по себе. Подробнее почитать можно тут.

Luma под конец недели показала Uni-1: авторегрессивный трансформер, который сначала думает, а потом генерирует пиксели. Деталей пока мало, но идея интересная. Если модель сначала строит внутренний план сцены, а потом рисует, качество и управляемость генерации со временем могут заметно вырасти. Пока просто наблюдаем.

Уважаемый, ripgrep, мы тебя всё ещё любим. Но 16.8 секунд против 13 миллисекунд это уже разрыв, после которого начинаешь смотреть на старые инструменты с лёгкой ревностью. Может, не всё будущее за новыми моделями. Может, часть будущего за теми, кто просто делает агентам нормальные руки.

Оставайтесь любопытными.