Галлюцинации недели: Claude Opus 4.7, Qwen3.6 35B-A3B и конец pull request как формата

Пока твиттер спорит, поумнел Opus или нет, Codex уже переехал жить в ваш мак, а Hermes на этом фоне незаметно превращается в полноценную альтернативу OpenClaw.

Anthropic на неделе выпустил Claude Opus 4.7. Обещают лучшую работу с долгими задачами, кодом, следованием инструкциям и самопроверкой. Цена прежняя, $5 / $25 за 1M входных и выходных токенов. Рядом появился новый reasoning effort xhigh, между high и max. Claude Code по умолчанию теперь сидит именно на xhigh, и это намёк, что модель заточена скорее под "налей и отойди", чем под парное программирование. Я лично 80% времени сижу на medium и иногда переключаю на high.

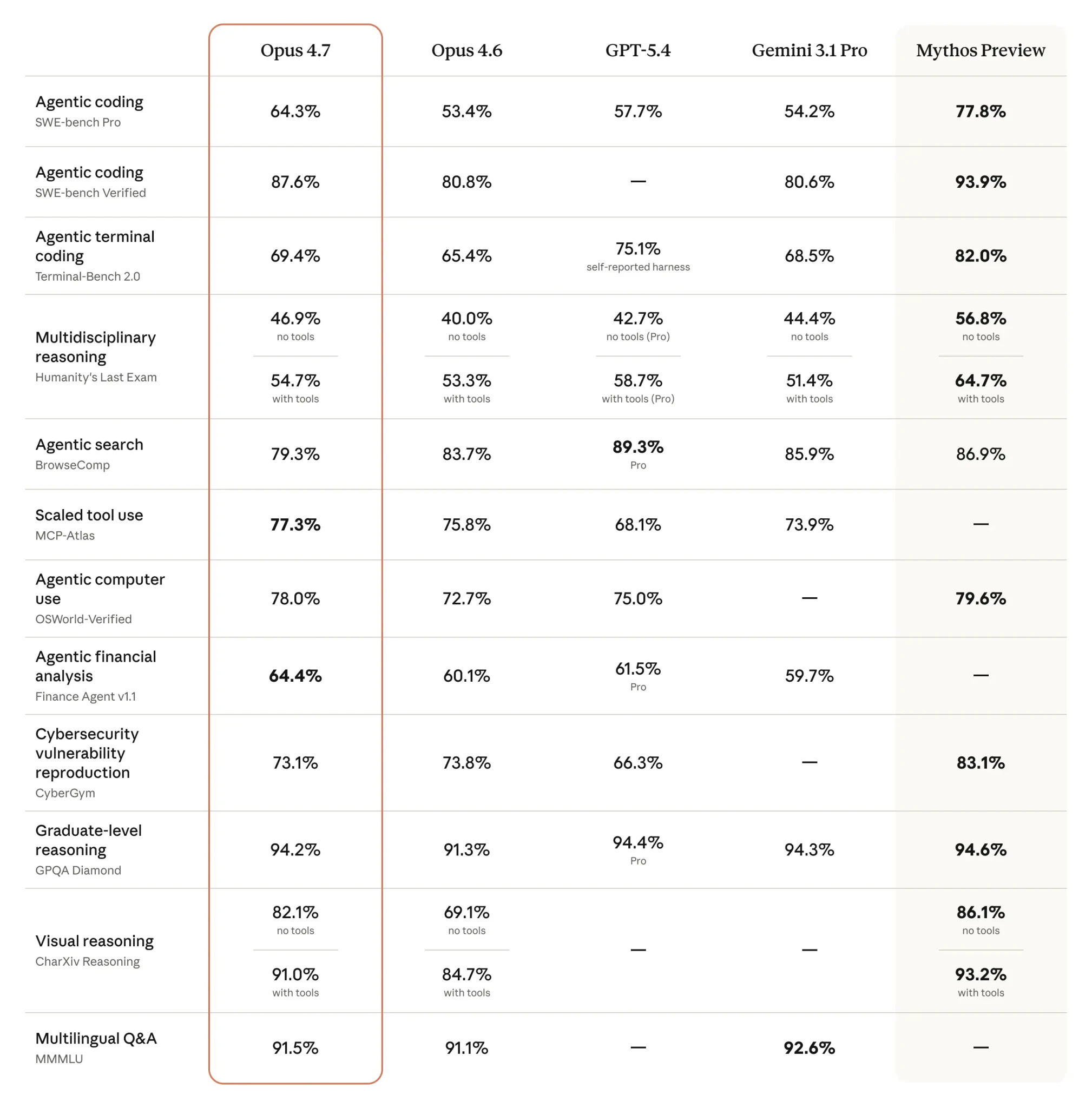

На бенчмарках картина бодрая. SWE-bench Pro 64.3% (+11 против 4.6), SWE-bench Verified 87.6% (+7), TerminalBench 2.0 69.4%. По Artificial Analysis, на Intelligence Index сложилась почти равная тройка: Opus 4.7 57.3, Gemini 3.1 Pro 57.2, GPT-5.4 56.8. Cursor на своём внутреннем бенчмарке прыгнул c 58% до 70%, Notion получил +14% к качеству и треть ошибок в инструментах.

Параллельно Anthropic показал Claude Design. Research preview, генерирует прототипы, слайды и одностраничники по текстовому описанию, с экспортом в Canva/PPTX/PDF/HTML и передачей в Claude Code. Твиттер сразу сравнил его с Figma, Lovable и v0, а акции Figma на анонсе просели. Anthropic явно решил, что их территория не заканчивается на чате и коде.

У Opus 4.7 сменили токенизатор, и тот же ввод теперь считается в 1.0–1.35x больше токенов. Борис Черный из команды Claude Code быстро поднял лимиты подписчикам, но API-клиенты достали канкуляторы. Параллельно просел MRCR v2 на 1M токенов: 78.3% → 32.2%. Борис ответил, что MRCR награждает трюки с distractor-stacking, и показал Graphwalks 38.7% → 58.6% как более полезную метрику. Независимый NYT Connections Extended отсыпал ещё: 4.6 набирал 94.7%, 4.7 (high) скатился до 41.0%. Автор бенчмарка уточнил, что дело тут в отказах по безопасности, а не в ошибках рассуждения, на разрешённых задачах модель даёт 90.9%. В твиттере параллельно две реакции: одни обзывают новый системный промпт "лоботомированным", другие пишут, что модель впервые "понимает", что они пытаются сделать.

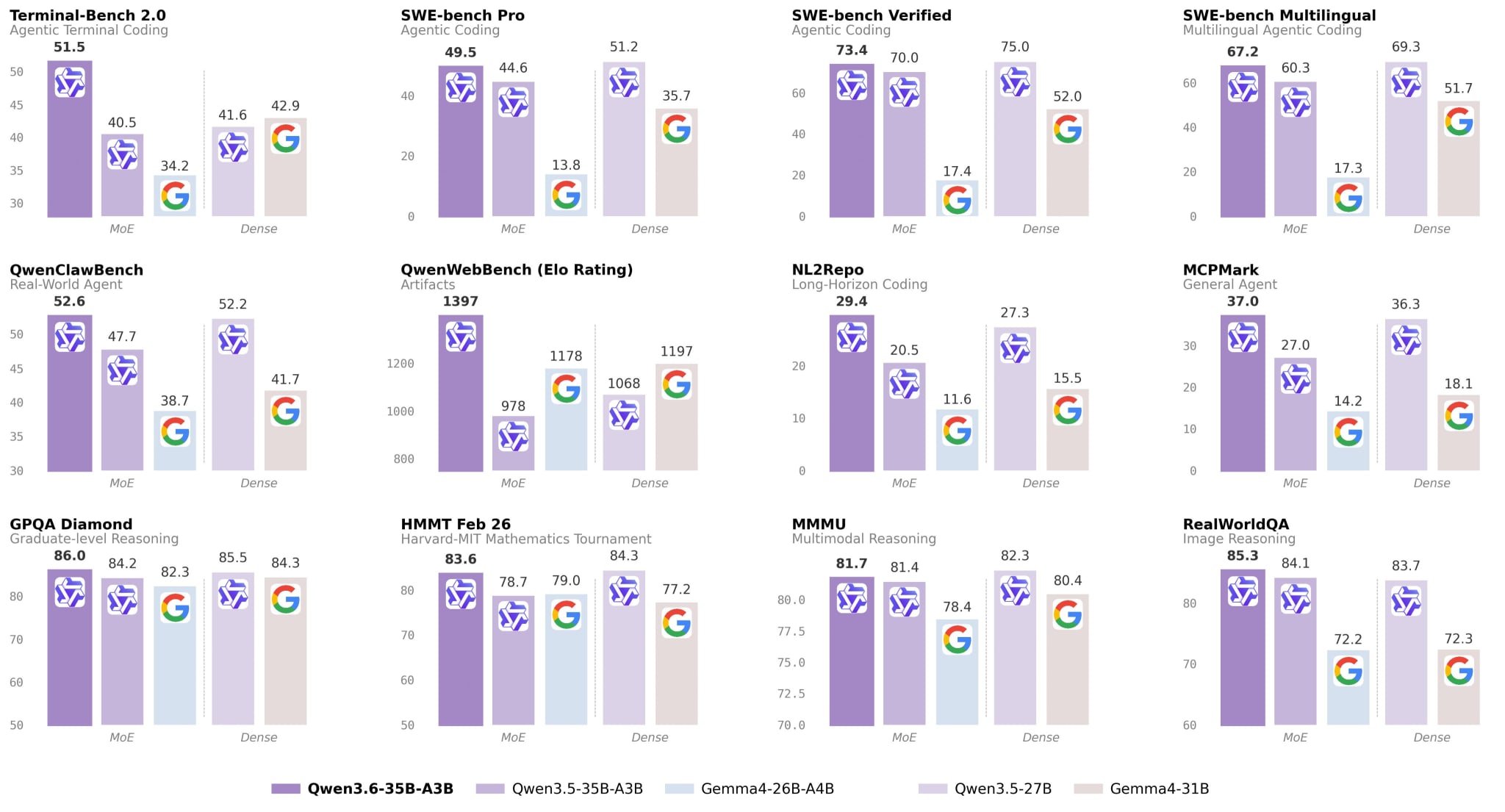

Alibaba выпустил Qwen3.6-35B-A3B — sparse MoE на 35B общих и 3B активных параметров, Apache 2.0, с нативной мультимодальностью. SWE-bench Verified 73.4, Terminal-Bench 2.0 51.5, RefCOCO 92.0. Unsloth показал, что GGUF-версия запускается в 23GB RAM, а 2-битный вариант на 13GB, и в этом виде чинит баги в репо. vLLM и Ollama получили поддержку в день релиза. Для локального стека это очень важное событие: модель, которая раньше требовала серверной стойки, теперь умещается в ноутбук и дышит в спину старшеклассникам на агентских задачах. GGUF, гайд.

OpenAI на неделе превратил Codex в полноценного оператора macOS. Обновление принесло computer use на Mac, встроенный браузер, gpt-image-1.5, 90+ плагинов, несколько терминалов, SSH в devbox'ы, долгоживущие автоматизации и память. Президент OpenAI Greg Brockman прямо называет Codex "агентным IDE". Сам OpenAI пишет про 3M активных пользователей в неделю, и почти половина использования уже не про код. В комьюнити отдельно подчёркивают, что Codex Computer Use работает быстро, включая Slack и старый enterprise-софт.

Google выкатил нативное приложение Gemini для Mac. Активация по Option + Space, доступ к экрану и локальным файлам, написано на нативном Swift. Поверх этого Personal Intelligence поехал глобально в Gemini и Chrome, с возможностью подключать Gmail и Google Photo. Технически интереснее другое, Gemini 3.1 Flash TTS: Audio Tags, 70+ языков, невербальные подсказки прямо в тексте, мультиспикер, водяной знак SynthID. Artificial Analysis ставит его на #2 в Speech Arena, всего 4 Elo позади лидера. Если Anthropic зашёл на территорию Figma, то Google одновременно зашёл в Notion, Apple Intelligence и ElevenLabs.

Cloudflare показал Project Think, Agents SDK нового поколения с durable execution, субагентами, изолированным исполнением кода и встроенной файловой системой рабочего пространства. Поверх этого Agent Lee, агент прямо в дашборде, который через изолированный TypeScript заменяет ручную навигацию по вкладкам на операции по промпту. Cloudflare раз за разом продаёт один тезис: агент в продакшне вырастает из связки durable runtime, UI-grounding, браузера, голоса и sandbox.

В тот же день OpenAI открыл свой Agents SDK и отвязал harness от вычислений. Harness теперь open-source, а исполнение можно отдать партнёрскому sandbox'у. За несколько часов интеграции объявили Cloudflare, Modal, Daytona, e2b и Vercel. Паттерн один у всех: оркестратор без состояния плюс изолированные рабочие пространства с состоянием. LangChain тем же движением выкатил deepagents 0.5 с асинхронными субагентами, мультимодальной работой с файлами и улучшенным кэшированием промптов, а deepagents deploy позиционируется как open-аналог управляемому хостингу для агентов.

Hermes Agent продолжает развиваться. Nous выпустил v0.9.0 с веб-дашбордом, быстрым режимом, резервным копированием и импортом, усиленной безопасностью, iMessage/WeChat и поддержкой Android через tmux. hermes-lcm v0.2.0 добавил управление контекстом без потерь с DAG-саммари. Ollama нативно поддержал Hermes через ollama launch hermes. На GitHub у проекта уже 104k звёзд, при том что репо на хайпе всего пару месяцев. Ключевая фишка Hermes в том, что он превращает завершённый сценарий в переиспользуемый Skill. Интересный пример из твиттера: агент сам загрузил skill, диагностировал NaN-нестабильность в Gemma 4, патчил библиотеку, прогонял бенчмарки и публиковал артефакт на Hugging Face.

Создатель OpenClaw Питер Штайнбергер выступил на TED и AIE с двумя версиями истории проекта. Публике рассказал про самый быстрорастущий open-source проект в истории. Инженерам выдал версию трезвее: отчётов по безопасности у них в 60 раз больше, чем у curl, а минимум 20% контрибуций в skills были зловредными. Проект реально заработал, и он же превратился в одну из самых атакуемых цепочек поставок в индустрии. Сложно не увидеть параллель с Hermes, где усиление безопасности вынесли отдельным пунктом в changelog: open-source агент-стеки становятся легитимной целью для атак.

GitHub впервые разрешил отключать pull request'ы в open-source репо, и это на фоне того, что Питер и ещё несколько заметных мейнтейнеров уже пару лет пушат идею Prompt Requests вместо Pull Requests. Логика такая: нет merge-конфликтов, мейнтейнеру проще править промпт, чем чужой код, и меньше шансов, что под невинным PR проедет вредоносный код. CEO Box Аарон Леви в Building for Trillions of Agents формулирует финал: "путь вперёд в том, чтобы делать софт, который хотят агенты". Git придуман для людей, и если код начинают писать и ревьюить не люди, то и формат доставки перестаёт иметь смысл. Вопрос теперь звучит иначе: сколько ещё продержится сам git.

Когда OpenAI пишет, что половина использования Codex — не про код, я узнаю в этой цифре себя. В Claude Code и Codex у меня уже несколько месяцев крутятся задачи, до которых обычно не доходят руки, и именно там от агента больше всего пользы. В какой-то момент ловлю себя на мысли, что агент выручает не там, где ты силён, а там, где у тебя обычно заканчивается терпение.

Оставайтесь любопытными.